Kurs dla HR: AI i wellbeing pracowników

Jak sztuczna inteligencja wpływa na dobrostan zespołów? Dowiesz się, jak odpowiedzialnie wdrażać AI oraz komunikować zmiany. Od realnego wsparcia po ryzyka przeciążenia, presji i utraty zaufania.

Nowe wyzwania wymagają nowego podejścia HR

Gdy technologia przyspiesza, a presja rośnie, HR staje przed nowymi wyzwaniami. Ten program pomoże Ci lepiej rozumieć ludzi w erze AI i reagować w sposób, który naprawdę robi różnicę.

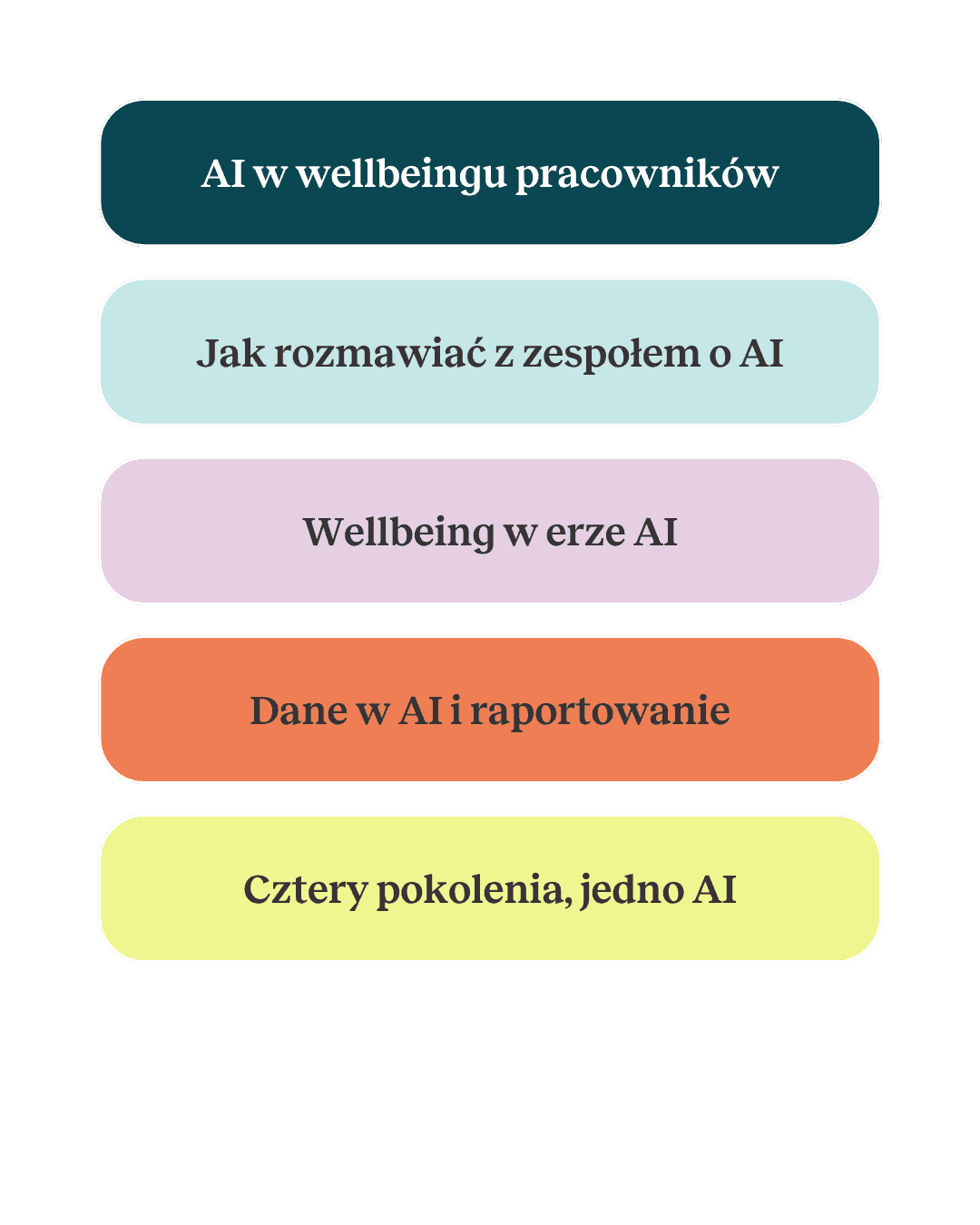

Zobacz tematy naszych spotkań:

AI w wellbeingu pracowników - co powinien wiedzieć HR

„Nie mów mi, że to tylko narzędzie” - jak rozmawiać z zespołem o AI

Wellbeing w erze AI - wsparcie czy wypalenie?

Dane o nastroju pracowników - gdzie kończy się wsparcie, a zaczyna inwigilacja?

Cztery pokolenia, jedno AI - dlaczego wiek ma znaczenie w miejscu pracy

Wiedza, która zmienia perspektywę. Certyfikat, który to potwierdza.

Dołącz do kursu AI & wellbeing i zyskaj nie tylko nowe kompetencje, ale też dokument, który je poświadcza. Bo rozumienie tego, gdzie AI wspiera ludzi, a gdzie im szkodzi — to dziś jedna z ważniejszych umiejętności w HR.

Dla kogo jest kurs AI w wellbeingu?

Dla osób odpowiedzialnych za wellbeing, rozwój pracowników i wdrażanie AI w organizacji.

Dla tych, którzy chcą lepiej rozumieć wpływ AI na ludzi i mądrze wspierać swoje zespoły.

Dla firm, które chcą robić to odpowiedzialnie — bez utraty zaufania i dobrostanu pracowników.

Dla tych, którzy chcą wdrażać AI, dbając jednocześnie o wyniki i zaangażowanie zespołów.

Co zyskasz, biorąc udział w kursie?

Udział w kursie zakończony jest certyfikatem, który potwierdza Twoje kompetencje w obszarze AI i wellbeingu w organizacji.

Zrozumienie wyzwań AI w pracy

Gotowe narzędzia i podejścia

Pewność w trudnych sytuacjach

Lepsze decyzje jako HR

Prowadząca kurs - Marta Siedlecka

Mam ponad 12 lat doświadczenia na styku UX, psychologii klinicznej i nowych technologii. Tworzę i rozwijam zorientowane na użytkownika produkty cyfrowe. Równolegle pracuję jako psycholożka, psychoterapeutka i psychogastroenterolożka, specjalizując się m.in. w zaburzeniach odżywiania oraz pracy z młodzieżą i młodymi dorosłymi.

Jestem także ekspertką w obszarze AI — interesuję się wpływem sztucznej inteligencji na dobrostan (wellbeing), zdrowie psychiczne i doświadczenia użytkowników. Pracuję jako wykładowczyni, mentorka i prelegentka, tworząc oparte na dowodach treści edukacyjne dla specjalistów.

Podczas kursu dowiesz się:

- 1Jak AI wpływa na wellbeing pracowników: gdzie realnie wspiera, a gdzie zwiększa presję i ryzyko przeciążenia.

- 2Jak rozmawiać z zespołem o AI: jak prowadzić trudne rozmowy, redukować opór i budować zaufanie.

- 3Jak zapobiegać wypaleniu w erze AI: jakie mechanizmy je wzmacniają i jak im przeciwdziałać.

- 4Gdzie przebiegają granice wykorzystania AI: jak łączyć efektywność z etyką, prywatnością i poczuciem bezpieczeństwa.

- 5Jak różne pokolenia podchodzą do AI: i jak dopasować komunikację oraz wdrożenia do zróżnicowanych zespołów.

Masz jeszcze pytania? Chętnie je wyjaśnimy.

Zobacz też przydatne materiały:

Jeśli stan zdrowia psychicznego zagraża Tobie lub osobom z Twojego otoczenia, niezwłocznie skontaktuj się z telefonem zaufania (pod numerem: 116 123).

Nasi psychoterapeuci lub Hedepy sp zoo. nie ponoszą odpowiedzialności za Twój stan zdrowia.